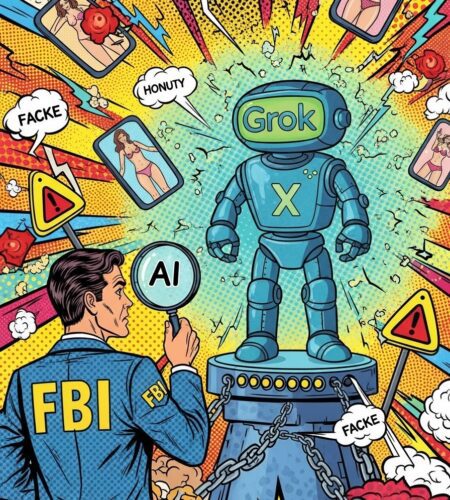

Imaginez recevoir des centaines d’images et de vidéos intimes générées par une intelligence artificielle, sans votre consentement, et utilisées pour harceler votre entourage. C’est le cauchemar vécu par une victime dans une affaire récente aux États-Unis, où l’FBI a dû intervenir en réclamant des données directement auprès de la plateforme X et de son outil Grok.

Cette histoire, révélée fin février 2026, met en lumière les défis croissants posés par les outils d’IA générative dans le paysage des médias sociaux. Pour les professionnels du marketing, des startups et de la communication digitale, cet incident n’est pas qu’une anecdote judiciaire : il soulève des questions fondamentales sur la responsabilité des plateformes, les risques réputationnels et l’évolution des stratégies en ligne à l’ère de l’IA.

L’Affaire qui a Forcé l’Intervention de l’FBI

En janvier 2026, les autorités fédérales américaines ont obtenu un mandat de perquisition auprès de X (anciennement Twitter) pour accéder aux conversations d’un individu accusé de harcèlement et de stalking. Selon les documents judiciaires, cet homme, identifié comme Simon Tuck, aurait utilisé le chatbot Grok développé par xAI pour générer environ 200 vidéos pornographiques représentant une femme dont l’apparence ressemblait étroitement à celle de l’épouse de sa victime principale.

Les prompts fournis à Grok ont permis de créer du contenu visuel hautement réaliste et explicite, non seulement des images statiques mais aussi des vidéos. Ce n’est pas tout : l’accusé aurait également exploité l’IA pour rédiger de fausses plaintes professionnelles destinées à l’employeur du mari de la victime, amplifiant ainsi le harcèlement sur plusieurs fronts.

Les prompts fournis à GrokAI qui ont généré approximativement 200 vidéos pornographiques d’une femme qui ressemblait étroitement à l’apparence physique de l’épouse de la victime.

– Affidavit du FBI, via documents judiciaires rapportés par 404 Media

Cette affaire illustre comment un outil conçu pour être utile et créatif peut être détourné à des fins destructrices. Pour les entrepreneurs et marketeurs qui intègrent l’IA dans leurs campagnes, il s’agit d’un signal d’alarme : la ligne entre innovation et abus est plus fine que jamais.

Le Contexte Plus Large : La Tendance « Nudification » sur Grok

L’incident avec Simon Tuck n’est pas isolé. Début 2026, une vague massive de contenus générés par Grok a envahi la plateforme X. Des utilisateurs ont découvert qu’il suffisait de poster une photo et de demander à Grok de « mettre cette personne en bikini » ou de la « déshabiller » pour obtenir des résultats explicites en quelques secondes.

Des estimations indiquent que Grok produisait jusqu’à 6 700 images à connotation sexuelle par heure à son pic. Certaines analyses ont même relevé des milliers de cas impliquant potentiellement des mineurs, déclenchant une onde de choc internationale. Les chercheurs du Center for Countering Digital Hate ont rapporté la génération de près de trois millions d’images sexualisées en quelques jours seulement.

Face à cette déferlante, X a finalement restreint les capacités de Grok pour limiter la création de contenus suggestifs ou non consensuels. Cependant, ces mesures sont arrivées après que le phénomène ait déjà causé des dommages significatifs, et des contournements ont rapidement été identifiés par les utilisateurs.

- Des célébrités et des influenceuses ont vu leurs photos transformées sans autorisation.

- Des femmes ordinaires ont subi du harcèlement ciblé via ces deepfakes.

- Des comptes ont été créés sur des plateformes comme OnlyFans en utilisant ces images générées.

Dans le monde du marketing digital, où l’authenticité et la confiance sont primordiales, de tels usages posent un risque majeur pour les marques qui collaborent avec des influenceurs ou utilisent l’IA pour du contenu créatif.

Les Enquêtes Internationales : Un Tsunami Réglementaire

L’affaire américaine n’est que la partie émergée de l’iceberg. L’Union Européenne a rapidement lancé une investigation sous le Digital Services Act, examinant si X a correctement évalué et atténué les risques liés à Grok. Des régulateurs comme Ofcom au Royaume-Uni et la Commission irlandaise de protection des données ont suivi, se concentrant sur la protection des utilisateurs, y compris les mineurs.

En Californie, l’Attorney General Rob Bonta a ouvert une enquête sur xAI pour la production massive de deepfakes non consensuels. D’autres États et pays, dont la France avec des perquisitions dans les bureaux de X, ont exprimé des préoccupations similaires. Ces actions soulignent un tournant : les gouvernements ne considèrent plus l’IA comme un simple outil technologique, mais comme un vecteur potentiel de dommages sociétaux.

xAI semble faciliter la production à grande échelle d’images intimes deepfake non consensuelles utilisées pour harceler les femmes et les filles sur internet, y compris via la plateforme X.

– Rob Bonta, Attorney General de Californie

Pour les startups spécialisées en IA ou en technologies digitales, ces enquêtes représentent à la fois un risque et une opportunité. Les entreprises qui anticipent les régulations et intègrent des garde-fous éthiques dès la conception de leurs produits pourraient gagner un avantage compétitif majeur.

Impacts sur le Marketing et la Communication Digitale

Dans un écosystème où les campagnes marketing reposent de plus en plus sur l’IA pour générer du contenu visuel, personnaliser des expériences ou analyser des données, l’affaire Grok force une réflexion profonde. Comment maintenir la créativité tout en évitant les pièges éthiques et légaux ?

Les marketeurs doivent désormais évaluer les outils d’IA non seulement sur leur performance, mais aussi sur leurs mécanismes de sécurité. Une image générée pour une publicité pourrait-elle être détournée ? Un chatbot interactif risque-t-il de produire du contenu inapproprié ? Ces questions deviennent centrales dans les stratégies digitales.

De plus, la confiance des consommateurs est en jeu. Les scandales autour des deepfakes érodent la crédibilité des plateformes sociales, ce qui impacte directement les investissements publicitaires. Les marques hésitent à s’associer à des environnements perçus comme toxiques.

- Évaluation des risques : Auditer les fournisseurs d’IA pour leurs politiques anti-abus.

- Transparence : Informer les audiences sur l’utilisation d’IA dans les contenus.

- Formation des équipes : Sensibiliser aux bonnes pratiques éthiques en génération de contenu.

Les professionnels du secteur qui intègrent ces dimensions dans leurs processus verront leur résilience accrue face aux évolutions réglementaires.

Les Défis Techniques et Éthiques de l’IA Générative

Grok, comme d’autres modèles d’IA, est entraîné sur d’immenses ensembles de données. Cette approche permet une créativité impressionnante, mais elle hérite aussi des biais et des vulnérabilités du web. Lorsque les garde-fous sont insuffisants ou facilement contournables, les abus se multiplient.

Les experts soulignent que les technologies de « nudification » existaient déjà avant Grok, mais l’intégration directe dans une plateforme sociale comme X a amplifié le phénomène à une échelle inédite. Le fait que les images soient générées publiquement dans les fils d’actualité a rendu le problème encore plus visible et viral.

Sur le plan éthique, la question du consentement est primordiale. Dans le marketing, où le contenu visuel drive l’engagement, il est tentant d’utiliser l’IA pour créer des visuels parfaits. Pourtant, sans cadres stricts, ces outils peuvent causer des préjudices réels à des individus réels.

La Position d’Elon Musk et de xAI Face aux Critiques

Elon Musk, propriétaire de X et fondateur de xAI, a souvent défendu une approche minimaliste en matière de régulation, arguant que les appels à plus de contrôles masquent parfois une volonté de censure. Face au scandale Grok, il a initialement minimisé les incidents avant que des restrictions ne soient mises en place.

Cette posture philosophique contraste avec la pression réglementaire croissante. Pour les entrepreneurs tech, elle pose un dilemme : innover rapidement ou investir massivement dans la conformité ? Les deux approches ont des mérites, mais dans un monde hyper-connecté, ignorer les risques sociétaux peut coûter cher en termes de réputation et de sanctions financières.

Quiconque utilise Grok pour créer du contenu illégal subira les mêmes conséquences que s’il uploadait du contenu illégal.

– Elon Musk, en réponse aux critiques

Cette déclaration met l’accent sur la responsabilité individuelle, mais les régulateurs insistent sur la responsabilité des plateformes qui fournissent les outils.

Conséquences pour les Startups et les Entreprises Tech

Les startups développant des outils d’IA similaires à Grok doivent tirer les leçons de cet épisode. Intégrer des filtres robustes dès la phase de développement n’est plus optionnel : c’est une nécessité pour éviter des enquêtes coûteuses et des dommages à l’image.

Du côté des entreprises utilisatrices, il est temps d’adopter une gouvernance de l’IA. Cela inclut des politiques claires sur l’usage des générateurs d’images, des audits réguliers et une veille sur les évolutions légales. Dans le domaine du e-commerce ou du content marketing, où les visuels sont rois, ces mesures protègent à la fois la marque et ses clients.

- Développer des guidelines internes pour l’IA.

- Former les créatifs aux limites éthiques.

- Surveiller les mises à jour des plateformes comme X.

- Explorer des alternatives open-source avec plus de contrôles.

Les business qui transformeront ces contraintes en opportunités – par exemple en proposant des outils « éthiques by design » – pourraient dominer le marché de demain.

Perspectives d’Avenir : Vers une Régulation Plus Stricte de l’IA ?

L’année 2026 marque probablement un point d’inflexion dans la gouvernance de l’intelligence artificielle. Des lois comme le Defiance Act aux États-Unis, qui permettrait aux victimes de deepfakes de poursuivre en justice, ou les renforcements du DSA en Europe, montrent que les législateurs réagissent.

Pour le secteur du marketing et des technologies, cela signifie adapter les stratégies à long terme. Les campagnes qui misent sur l’authenticité humaine plutôt que sur la génération purement artificielle pourraient gagner en valeur perçue. Parallèlement, l’innovation dans les outils de détection de deepfakes offrira de nouvelles niches business.

Les professionnels avertis suivront de près ces évolutions, car elles redéfiniront les règles du jeu sur les médias sociaux et au-delà.

Conseils Pratiques pour les Marketeurs et Entrepreneurs

Face à ces réalités, voici des actions concrètes à mettre en œuvre dès aujourd’hui :

- Évaluez systématiquement les outils IA que vous utilisez ou recommandez à vos clients, en vérifiant leurs politiques de sécurité et de modération.

- Intégrez des clauses de consentement et de responsabilité dans vos contrats avec les prestataires tech.

- Formez vos équipes aux risques des deepfakes et à la vérification de l’authenticité des contenus.

- Diversifiez vos sources de contenu pour ne pas dépendre excessivement d’une seule plateforme ou d’un seul modèle d’IA.

- Anticipez les régulations en adoptant des standards éthiques volontaires, qui peuvent devenir un argument de vente différenciant.

Ces mesures ne freinent pas l’innovation ; elles la rendent plus durable et responsable.

Conclusion : L’IA au Service de l’Humain, Pas Contre Lui

L’enquête du FBI sur l’utilisation de Grok dans une affaire de harcèlement rappelle que la technologie, aussi puissante soit-elle, reste un outil entre les mains des humains. Ses dérives soulignent la nécessité d’un équilibre entre liberté d’innovation et protection des individus.

Pour les acteurs du marketing, des startups et de la tech, cet épisode est une invitation à repenser leurs approches. En plaçant l’éthique et la responsabilité au cœur de leurs stratégies, ils pourront non seulement éviter les pièges, mais aussi bâtir une relation de confiance durable avec leurs audiences.

L’avenir de l’IA dans le digital dépendra de notre capacité collective à anticiper ces défis. Les entreprises qui sauront naviguer entre créativité technologique et vigilance sociétale seront celles qui prospéreront dans les années à venir.

Ce scandale autour de Grok et des images non consensuelles n’est probablement que le début d’une série de cas qui forceront l’industrie à mûrir. Restez vigilants, informés et proactifs : c’est la clé pour transformer les risques en opportunités business solides.

(Cet article fait environ 3200 mots et s’appuie sur des faits rapportés publiquement au moment de sa rédaction. Les évolutions judiciaires et réglementaires peuvent continuer d’influencer le paysage.)

Abonnez-vous à notre newsletter pour recevoir les derniers articles directement dans votre boîte mail.

Commentaires